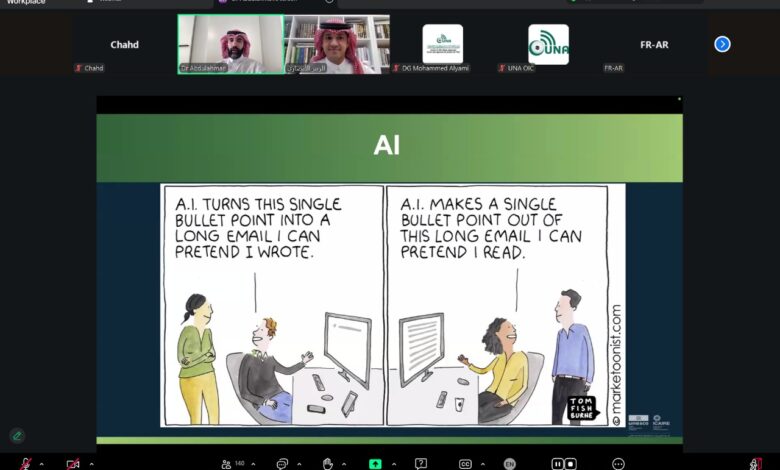

Jeddah (UNA) – Sammenslutningen af OIC-nyhedsbureauer (UNA) organiserede onsdag den 5. november 2025 en virtuel workshop med titlen: "Etik i brugen af kunstig intelligens-teknologier og virkningen af dens hallucinationer på medieindhold" i samarbejde med International Center for Research and Ethics in Artificial Intelligence (ICAIRE) med det formål at holde sig ajour med udviklingen inden for applikationer af kunstig intelligens og etikken i deres anvendelse samt at identificere de mest fremtrædende effekter af dens hallucinationer på medieindhold.

Workshoppen, som blev overværet af mere end 350 mediefolk fra nyhedsbureauer i medlemslandene i Organisationen for Islamisk Samarbejde samt mediefolk fra andre enheder, havde også til formål at forbedre indholdsskabelsen og øge mediefolks bevidsthed om medlemslandenes medier.

Generaldirektøren for Unionen af OIC News Agencies (UNA), professor Mohammed bin Abdulrab Al-Yami, gentog sin advarsel om problemer relateret til kunstig intelligens og fremhævede måder at håndtere disse problemer i medie- og kommunikationsmiljøer på en måde, der er i overensstemmelse med de principper og værdier, der styrer mediearbejdet. Under workshoppen understregede han, at selvom kunstig intelligens-applikationer kan virke automatiserede i deres endelige output, er de menneskelige i deres oprindelse, programmering, datastrukturering og algoritmeudvikling. Det betyder, at de, ligesom enhver menneskelig indsats, er modtagelige for bias, stereotypisering og tjener politiske og ideologiske dagsordener under dække af objektivitet. Han påpegede, at de forskellige svar fra nogle af disse applikationer på det samme spørgsmål, afhængigt af de politiske og historiske kontekster, der er forbundet med spørgsmålene, nødvendiggør bevidsthed om de bias, der er forbundet med disse applikationer, og undgåelse af dem.

Al-Yami understregede også spørgsmålet om databeskyttelse og vigtigheden af at håndtere dette i overensstemmelse med gældende lovgivning på nationalt plan i lande og mediemiljøer, samt behovet for at skelne mellem indhold produceret udelukkende ved menneskelig indsats eller med begrænset hjælp fra kunstig intelligens, og indhold, der udelukkende er produceret ved hjælp af kunstig intelligens.

Generaldirektøren for UNA henledte opmærksomheden på spørgsmålet om "intellektuel ejendomsret, og hvordan kunstig intelligens-applikationer automatisk gemmer alle de tekster, der indsættes i dem, og derefter arbejder på at genbruge dem på andre måder, der krænker intellektuelle ejendomsrettigheder, idet han anså dette problem for at være et af de mest alvorlige og følsomme emner i medierne, samtidig med at han advarede om visse kunstig intelligens-modeller, der kan give journalister falske oplysninger, der påvirker opbygningen af historien eller mediematerialet."

Dr. Abdulrahman Al-Habib, supervisor for International Center for Research and Ethics of Artificial Intelligence, behandlede etikken omkring brugen af kunstig intelligens, dens udfordringer, fordele og risici, og understregede, at medierne generelt drager stor fordel af kunstig intelligens, men kunstig intelligens' afhængighed af algoritmer gør den forudindtaget på mange områder, som en af de mest fremtrædende udfordringer, udover deepfakes i fotografering og video, og den store indvirkning på nogle mennesker i en sådan grad, at de glemmer deres færdigheder på grund af den fuldstændige afhængighed af kunstig intelligens.

Dr. Al-Habib beskrev "hallucinationer" som et komplekst emne og bemærkede, at det får nogle til at løse problemer med kunstig intelligens med selve kunstig intelligens og får dem til at gå fra at bygge ét program til et andet. Han påpegede, at nogle udfordringer ikke har nogen løsninger.

Han berørte også spørgsmålet om mediemanipulation og nævnte skrivning af falske og fabrikerede artikler ved hjælp af kunstig intelligens, formidling af misinformation og offentliggørelse af indhold beskyttet af intellektuelle ejendomsrettigheder.

Al-Habib opfordrede mediefolk til at være opmærksomme på risiciene ved kunstig intelligens for at vide, hvordan man håndterer den, i betragtning af eksistensen af juridiske, retslige og administrative ansvarsområder, især da kunstig intelligens-programmer er bygget på forudindtagede data.

(jeg er færdig)